AIモデルグローバル配信インフラ

LLM、画像生成、音声認識などAIアプリケーションのグローバル配信と推論高速化 - より速く、より安定、より安全に

グローバルノード

エッジ推論、近接サービス

レイテンシ

ミリ秒レスポンス

主要モデル対応

主流AIモデルのグローバルエッジ展開と推論高速化

LLM推論

GPT、Claude、Llamaなど大規模言語モデルの推論最適化

画像生成

Stable Diffusion、DALL-E、Midjourneyのエッジ展開

音声認識

WhisperとTTSモデルの低レイテンシ推論

マルチモーダルモデル

GPT-4V、Geminiマルチモーダルモデルのグローバル配信

AI向けに構築されたインフラ

企業のグローバルAIアプリケーション展開と配信を加速する方法をご紹介

グローバルスマートルーティング

3000+エッジノードで自動最適パス選択、近接推論を実現。200+か国をカバーし超高速AIモデル配信

コールドスタート最適化

モデルプリロードとキャッシュ技術で初回推論レイテンシ<100ms、ユーザー体験を劇的に向上

OpenAI

@OpenAI

GPT-4o 现已支持实时语音对话和视觉理解。

感谢 Yewsafe AI Gateway 提供的全球加速,API 延迟降低 60%。

Anthropic

@AnthropicAI

Claude 3.5 Sonnet 在代码生成和推理任务上取得突破性进展。

通过边缘节点优化,亚太区用户响应速度提升 3 倍。

Google DeepMind

@GoogleDeepMind

Gemini Pro 现已向全球开发者开放 API 接入。

智能路由让每一次推理请求都选择最优节点。

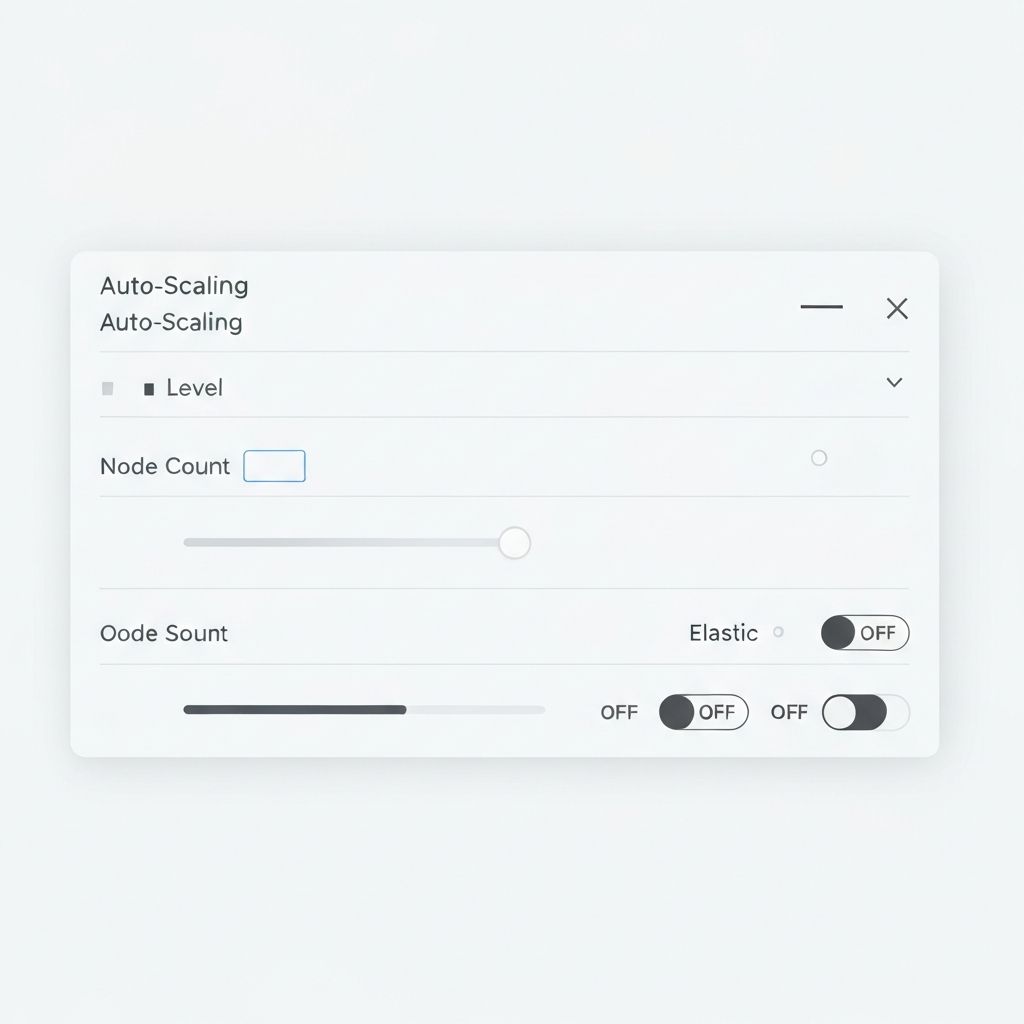

コスト最適化

スマートスケジューリングとキャッシュ最適化、従量課金で推論コストを最大60%削減

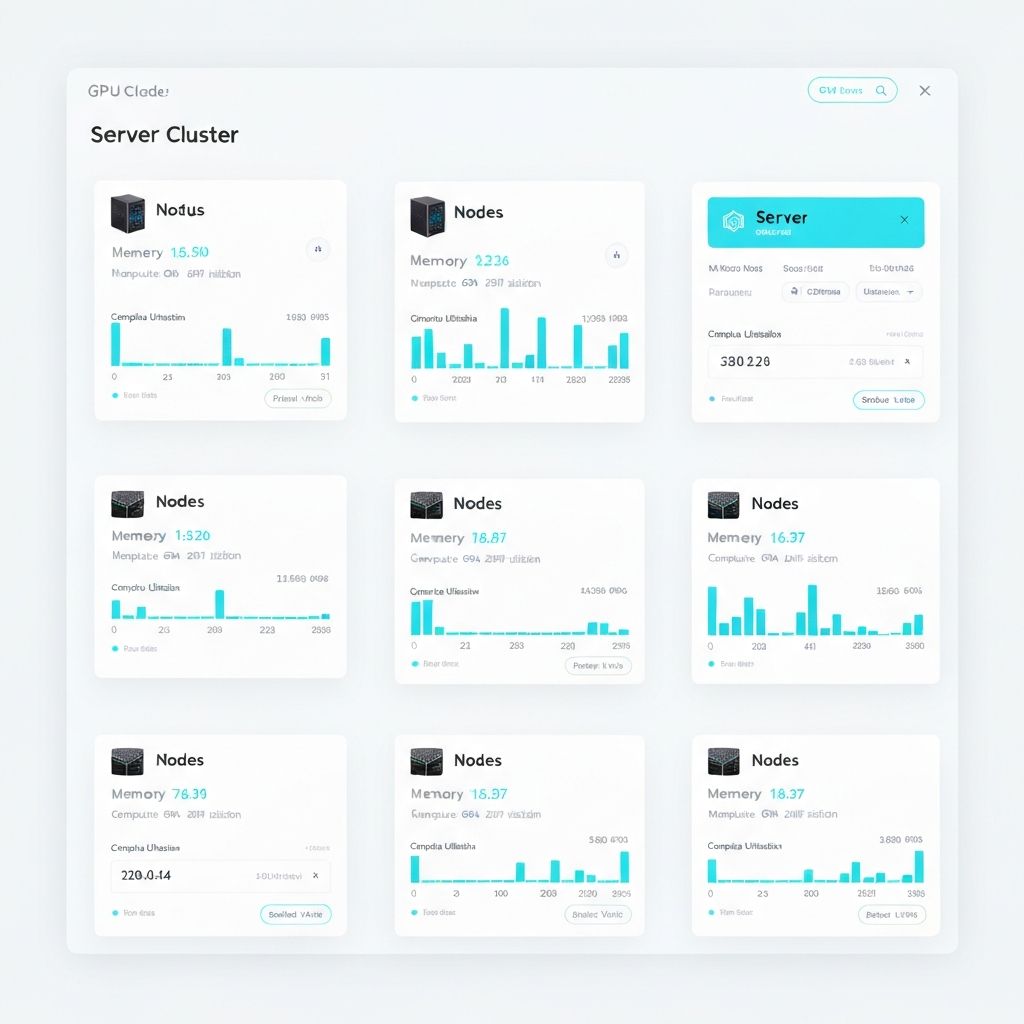

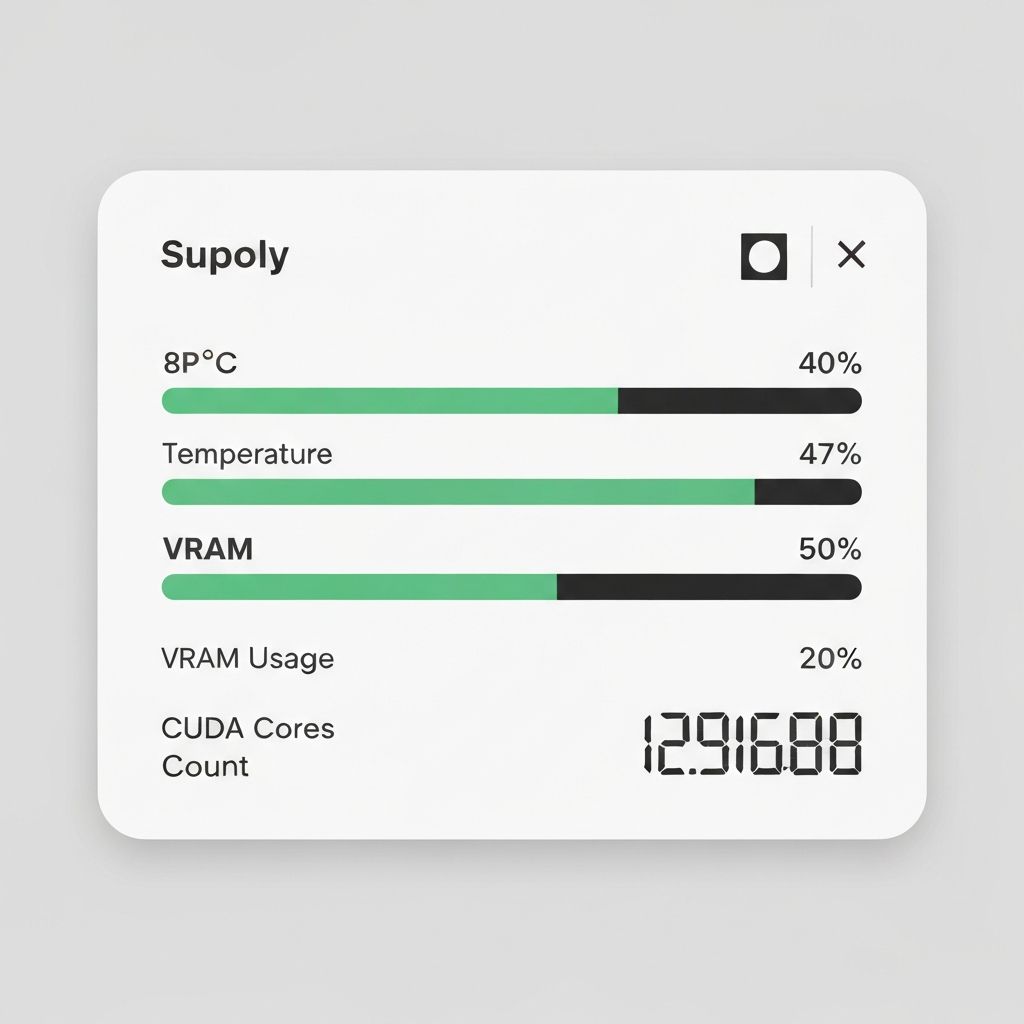

GPUエッジクラスター

グローバル分散GPUプールでトラフィックスパイク時の自動スケーリング、安定した推論サービスを保証

APIゲートウェイ

レート制限、クォータ、モニタリングを統合管理 - マルチモデルAPI呼び出しを簡単に管理

4つの簡単ステップでグローバル展開

API接続

1行で統合、OpenAI API互換

スマートルーティング

最適なエッジノードを自動選択

高速推論

GPUエッジクラスターとモデルキャッシュ

結果返却

低レイテンシ応答、エンドツーエンド暗号化

世界の業界リーダーに信頼されています

先進企業が当社のAI配信高速化サービスを選択し、グローバルユーザーにミリ秒レベルのAI推論レスポンスを提供。ユーザー体験とビジネス効率を大幅に向上させています。

よくある質問

AI Gatewayに関するよくある質問

技術チームが迅速にサポートいたします。

AIグローバル展開を始めましょう

無料トライアルでエンタープライズグレードのAI配信高速化を体験