AI 模型全球分发基础设施

为大语言模型、图像生成、语音识别等AI应用提供全球分发与推理加速,让AI服务更快、更稳定、更安全

全球节点

边缘推理,就近服务

推理延迟

毫秒级响应

旗舰模型支持

支持主流 AI 模型的全球边缘部署与加速推理

LLM 推理加速

大语言模型推理优化,支持 GPT、Claude、Llama 等主流模型

图像生成加速

Stable Diffusion、DALL-E、Midjourney 等图像模型边缘部署

语音识别加速

Whisper、语音合成等音频模型低延迟推理

多模态模型

GPT-4V、Gemini 等多模态模型全球分发

为AI而生的基础设施

探索我们如何帮助企业加速 AI 应用的全球部署与分发

全球智能路由

3000+ 边缘节点,自动选择最优路径,实现就近推理,覆盖 200+ 国家和地区,为 AI 模型提供极速分发体验

冷启动优化

模型预加载与缓存技术,首次推理延迟 < 100ms,大幅提升用户体验,告别漫长等待

OpenAI

@OpenAI

GPT-4o 现已支持实时语音对话和视觉理解。

感谢 Yewsafe AI Gateway 提供的全球加速,API 延迟降低 60%。

Anthropic

@AnthropicAI

Claude 3.5 Sonnet 在代码生成和推理任务上取得突破性进展。

通过边缘节点优化,亚太区用户响应速度提升 3 倍。

Google DeepMind

@GoogleDeepMind

Gemini Pro 现已向全球开发者开放 API 接入。

智能路由让每一次推理请求都选择最优节点。

成本优化

智能调度与缓存命中优化,通过按需计费和智能路由,降低推理成本达 60%

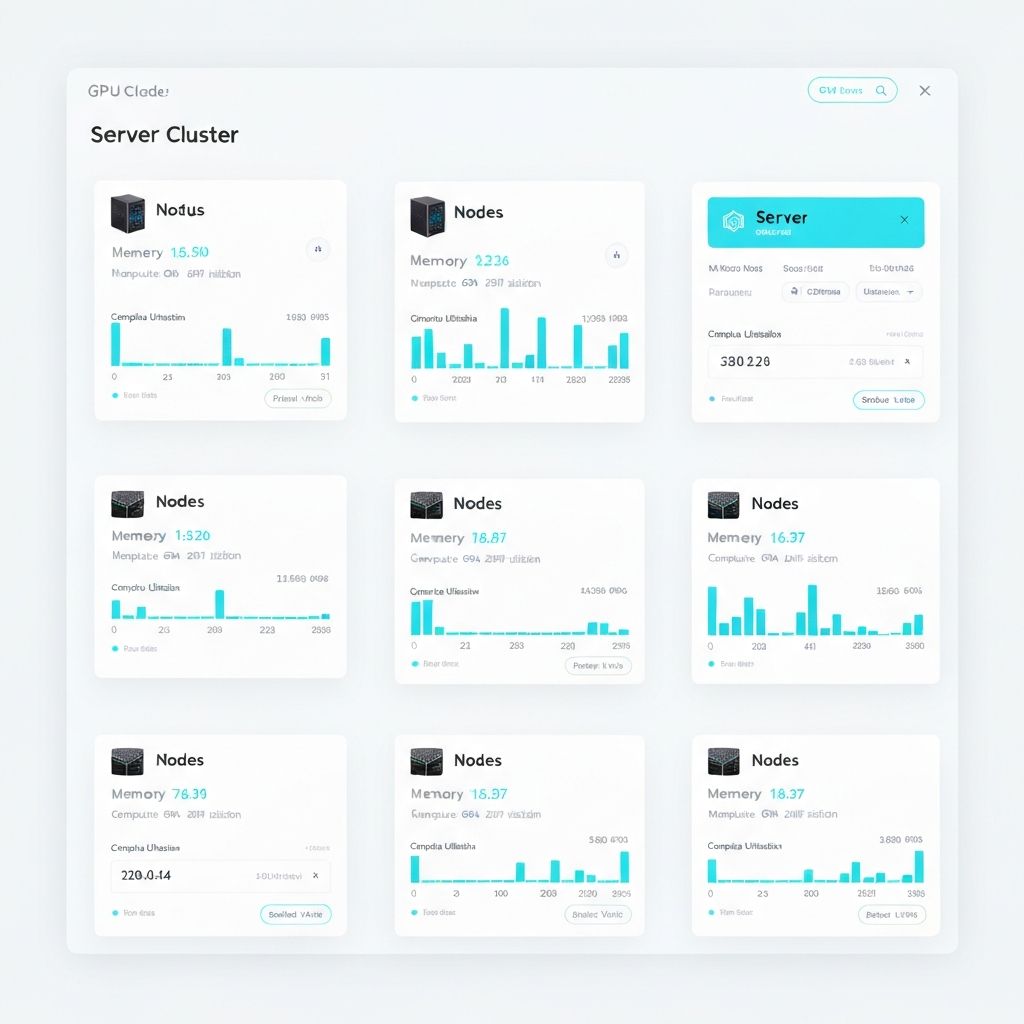

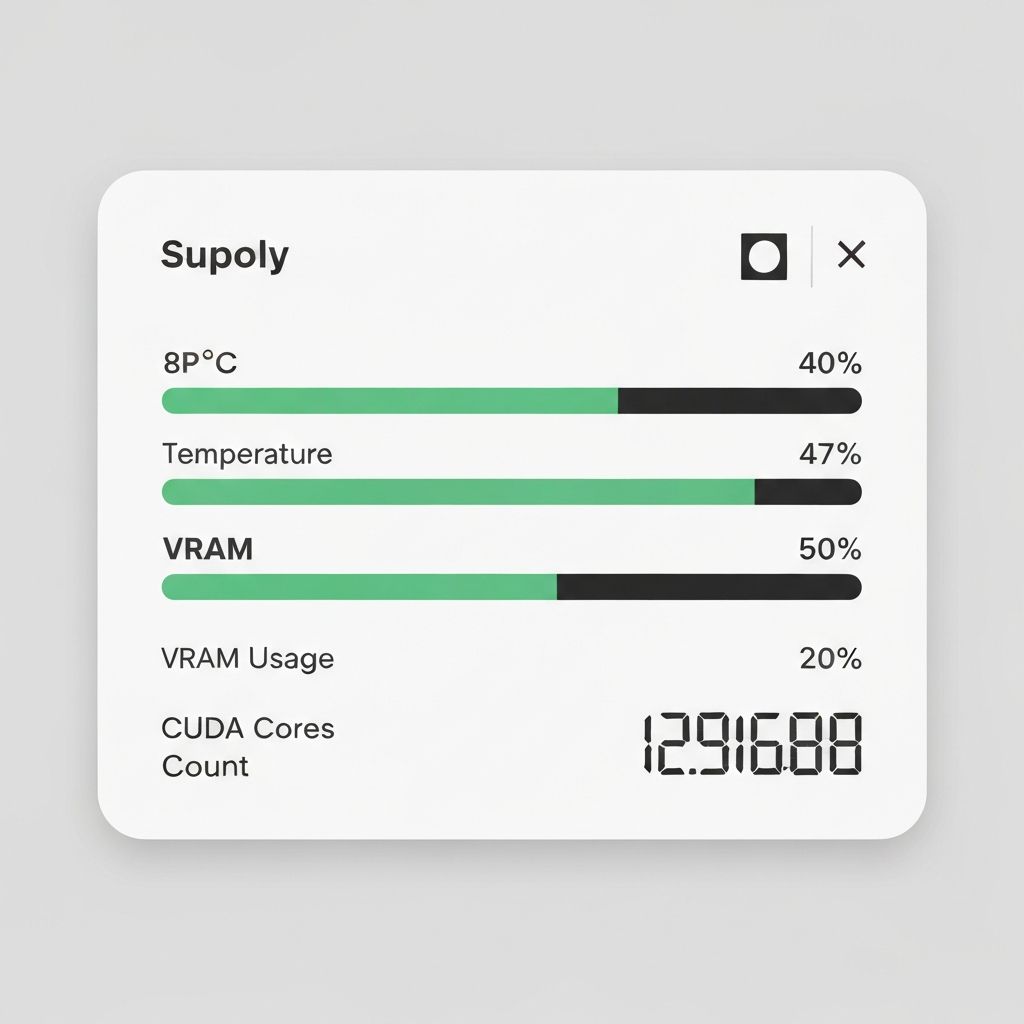

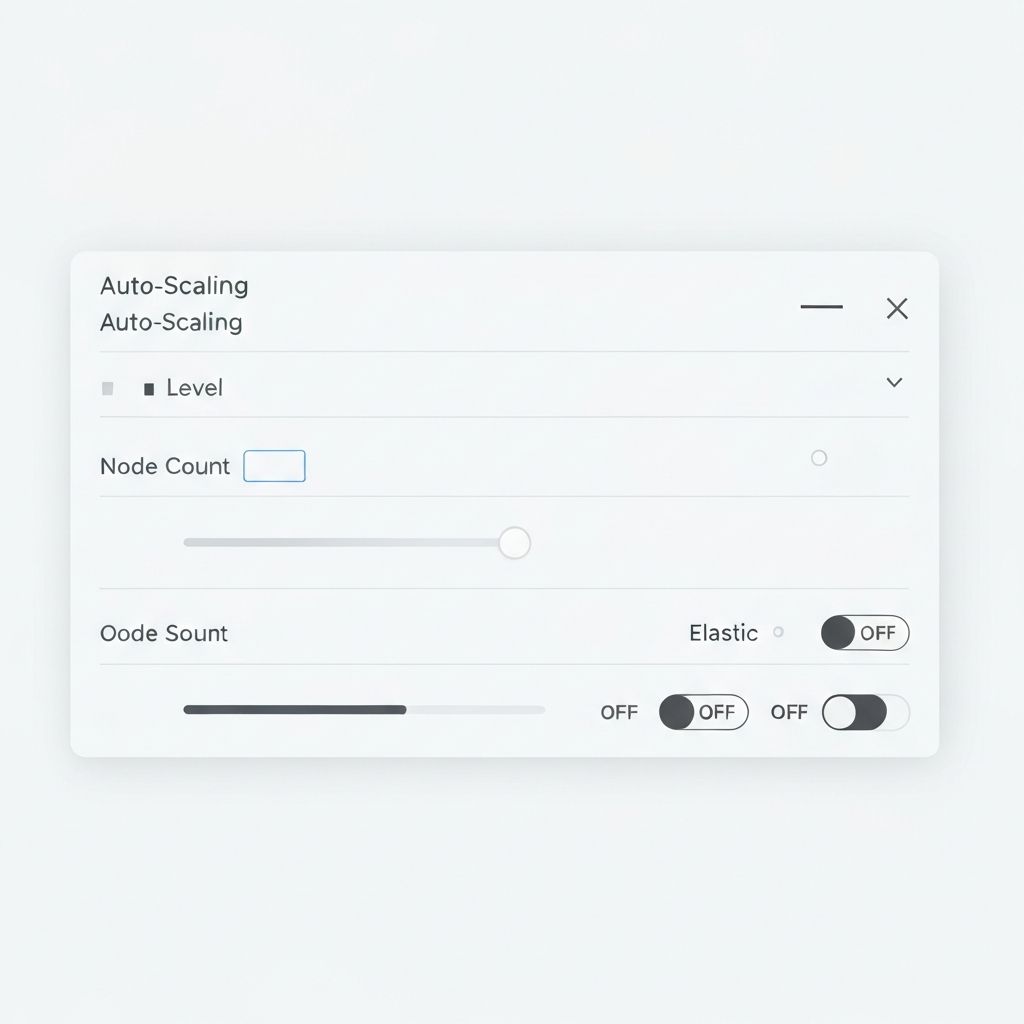

GPU 边缘集群

全球分布式 GPU 资源池,支持自动扩缩容,弹性应对流量峰值,确保推理服务稳定运行

API 网关

统一入口管理,速率限制、配额控制、请求监控,轻松管理多模型 API 调用

简单四步,全球部署

接入 API

一行代码接入,兼容 OpenAI API 格式

智能路由

自动选择最优边缘节点,就近推理

加速推理

GPU 边缘集群执行推理,模型缓存加速

返回结果

低延迟响应,全程加密传输

常见问题

关于 AI Gateway 的常见问题解答

我们的技术团队随时为您解答,确保快速响应。

开启AI全球化之旅

免费试用,体验企业级AI分发加速